| < Texte zu Themen | cikon.de | pdf 1,8 MB / english |

| Content

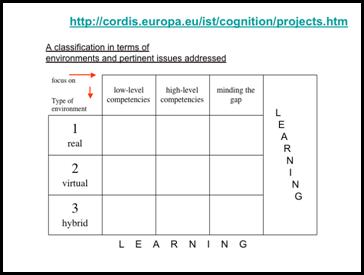

& Cognition v. Hans-Georg Stork* Was haben Content und Cognition, "Digital Content" und "Cognitive Systems" miteinander zu tun ? Eine ganze Menge, so behaupte ich, wenn wir uns auf ein geeignetes Verstaendnis der Begriffe einigen. Zunaechst "Content". Das deutsche Wort, "Inhalt", deckt leider nicht das ganze breite Spektrum ab, welches sich hinter der englischen Vokabel verbirgt. Diese bezeichnet, kurz gesagt, die externen und kommunizierbaren Repraesentationen, die wir Menschen von unseren Wahrnehmungen und Gedanken anfertigen koennen. Die besondere Auspraegung dieser Faehigkeit unterscheidet uns von so ziemlich allen anderen Lebewesen auf der Erde. Hier sind ein paar Beispiele:  Natuerlich fallen diese externen Repraesentationen nicht vom Himmel ("out of the blue"):  Vielmehr steckt dahinter die in Jahrmillionen entwickelte und ueber ihre jeweilige Lebenszeit gewachsene Materie und Struktur unserer Physis. Und darin, vor allem, das aus ca. 100 Milliarden Neuronen und etwa 10000-mal so vielen Synapsen bestehende zentrale Kontrollorgan, das Gehirn:  "Content" ergibt sich damit aus unserem durch das Gehirn vermittelte und reflektierte Erkennen und Erleben der Welt.  Die diesem zugrundeliegenden Vorgaenge wollen wir "Cognition" nennen. Tatsaechlich ist die Schaffung von "Content" eine der wichtigsten Weisen menschlichen Wirkens in der Welt. Ja, der von uns geschaffene "Content" wird zu einem festen Bestandteil der Welt, wie sich jedermann leicht ueberzeugen kann, der durch die Strassen geht oder auf's Buecherregal oder in die Fernsehroehre schaut.  Und somit selbst zum Gegenstand von Perzeption und Reflektion, von Kognition also. Das kann auf die Dauer - Stichwort “Informations-Überflutung” - ziemlich anstrengend sein. Aber gluecklicherweise erfahren wir seit geraumer Zeit zumindest potentiell Unterstuetzung bei unserem Bemuehen, sowohl die urspruengliche Sinneswelt als auch die von uns selbst geschaffenen kuenstlichen Welten zu verstehen und zu verarbeiten, und zwar etwa so:  Damit sind wir bei "Digital Content" und "Cognitive Systems" angelangt, oder wenigstens doch bei Systemen, welche unserer eigenen Kognition dienlich sind oder es doch sein sollten. Wir koennten von solchen Systemen, wenn wir sie auf die Analyse von “Digital Content” abrichten, zum Beispiel verlangen, dass sie diesen kategorisieren und uns verstaendliche Beschreibungen dessen liefern, was sie auf einem Bild “sehen".  Allerdings, ausser durch die Erzeugung von “Content” zeigen sich unsere kognitiven Faehigkeiten ganz allgemein in Aktionen, welche eine Veraenderung unserer Lebensbedingungen bewirken oder diese gar ausdruecklich zum Ziel haben.  Und es ist an dieser Stelle durchaus opportun zu bemerken, dass wir damit im Tierreich keineswegs allein stehen.  Wir Menschen haben, anders als die allermeisten Tiere, gezielt und bewusst hergestellte Maschinen und andere technische Systeme, die uns auch bei unseren vielfaeltigen "handfesten" Aktionen in der Welt unserer fuenf Sinne helfen. Doch koennten diese Systeme in vieler Hinsicht viel besser sein, als sie es heute schon sind. Zum Beispiel koennten sie uns, gewissermassen in eigener Regie (“autonom”), einen Grossteil der "kognitiven Last" abnehmen, die mit der Bewaeltigung der ihnen gestellten Aufgaben verbunden ist. Stattdessen muessen sie, im Grossen und Ganzen, alles auf unser Kommando und unter unserer Kontrolle tun. Autonome Maschinen zu bauen, ist ein uralter Traum der Menschen. Eine moegliche Inkarnation ist seit einigen Jahrzehnten unter anderem unter dem Begriff "Roboter" gelaeufig. Deren populaerste Vertreter haben gar, wie sollte es anders sein, menschliche Gestalt. Frankenstein und Golem lassen gruessen ...  Und hier ist eine ganze Menagerie … deren Nachfahren des Jahres 2050 den (menschlichen!) Fussballweltmeister besiegen sollen.  Aber es gibt auch solche, bei denen offenbar nicht-menschliche Lebewesen Pate gestanden haben:  All diese Maschinen und Systeme sollen keine Schachaufgaben und keine anderen klassischen Probleme der “Kuenstlichen Intelligenz” loesen und auch keinen Lagerbestand optimal kontrollieren. Aber sie muessen "ihre Sinne" beisammen haben, zum Beispiel, wenn es darum geht, einen bestimmten Gegenstand auch dann wiederzuerkennen, wenn dieser unter ganz anderem Blickwinkel, in ganz anderem Licht erscheint. Fuer andere Systeme ist es wuenschenswert, dass sie gesprochene Sprache und deren Sprecher auch vor lautem Hintergrundgeraeusch identifizieren koennen. Alle aber sollten etwas von ihrer Umwelt verstehen (wozu auch die dort gesprochene Sprache gehoeren kann), das heisst, sie sollten ihre Aktionen auf der Bedeutung dessen gruenden, das diese Aktionen erlaubt. Zum Beispiel sollten sie erkennen, wozu der Griff am Becher, eine Geschirrspuelmaschine, oder ein Buergersteig "gut sind", was sie damit machen koennen ("affordances").  In diesem Sinne kognitive Maschinen und Systeme muessen also nicht notwendigerweise auf der Hoehe der hoechsten menschlichen Intelligenz sein oder gar – wie wir – ein ausgeprägtes Bewusstsein haben. Was sie tun sollten, das koennen auch viele Tiere, Lebewesen also, denen weit weniger Gehirnschmalz zur Verfuegung steht, als uns Menschen. Und wir wissen noch nicht einmal, wie Tiere ihre vielfaeltigen Leistungen erbringen. Welche Ueberlegungen liegen dem EU Programm "Cognitive Systems" zugrunde und welche Ziele verfolgt es ? Vielen klugen Leuten, die auf diesem Gebiet arbeiten, ist es seit geraumer Zeit ziemlich klar, dass es neuer Ansaetze bedarf, um Maschinen und Systeme der eben beschriebenen Art herzustellen. Ansaetze, die ein gutes Stueck ueber das hinaus gehen, was wir gemeinhin unter “Good Old Fashioned Artificial Intelligence” (GOFAI) verstehen. Diese wird gern etwas polemisch durch die auf John Searle zurueckgehende Metapher des “Chinesischen Zimmers” charakterisiert. Dessen Bewohner versteht kein Wort Chinesisch, gibt aber dennoch auf alle ihm auf Chinesisch (schriftlich) gestellten Fragen sinnvolle Antworten, weil er auf ein komplettes syntaktisches Regelwerk zugreifen kann, welches Leute entworfen haben, die dieser Sprache maechtig sind. Er selbst kennt die Bedeutung dieser Regeln nicht.  Diese fast dreissig Jahre alte Metapher hat eine Kontroverse ausgeloest, die noch immer nicht voellig verstummt ist. Manche sagen (zB John Haugeland): "Don't worry, if you take care of the syntax the semantics will take care of itself". Andere sagen: "Abstrakte Syntax mit extern definierter Semantik allein wird bestenfalls ein virtuelles Sprachspiel produzieren und mit der sich staendig veraendernden und unsicheren realen Welt nicht Schritt halten koennen. Semantische Intelligenz ergibt sich nicht notwendigerweise aus syntaktischer Intelligenz." Diese Meinung laeuft hinaus auf die Forderung, abstrakte Symbole und Systeme in Realweltkontexten zu verankern, und reichere und dynamischere Repraesentationen der Bedeutung dessen zu schaffen, was in der Welt vor sich geht. Diese Meinung scheint sich in der Tat mehr und mehr durchzusetzen, und liegt letztlich auch unserem "Cognitive Systems (and Robotics)" Programm zugrunde.  So heisst es in einer der ersten Programm-Versionen, unter "Objectives" sinngemaess: Es sollen kuenstliche Systeme entwickelt werden, welche Daten verstehen (interpretieren), die sich aus Ereignissen und Vorgaengen in der realen Welt ergeben (hauptsaechlich mittels Sensoren aller Art); die situationsgemaesses Wissen ueber ihre Umgebung generieren; die handeln, entscheiden oder Entscheidungen vorschlagen; die mit Menschen "menschlich" kommunizieren und ihnen bei der Bewaeltigung komplexer Aufgaben helfen. Daran hat sich in der Folgezeit nichts Wesentliches geaendert. Durch eine Art "schrittweise Verfeinerung" allenfalls, wurden und werden diese Ziele weiter hinuntergebrochen und konkretisiert, wie man in den einschlaegigen Kapiteln der Webseite http://www.cognitivesystems.eu im Einzelnen nachlesen kann. Eine weitere Konstante gibt es seit Beginn des Programms: Die Betonung auf die "Staerkung der wissenschaftlichen Grundlagen von Entwurf und Implementierung kuenstlicher kognitiver Systeme". Damit werden nicht nur die einschlaegigen Formal- und Ingenieurdisziplinen sowie die klassischen Naturwissenschaften einbezogen, sondern auch Teile der Neuro- und Verhaltenswissenschaften (fuer Mensch wie Tier). Die Entwicklung und Fortentwicklung von Methoden des Maschinellen Lernens – in all seinen Variationen – spielt eine Schluesselrolle. Was ist beim “Cognitive Systems, Interaction, Robotics” Programm bisher herausgekommen ? In Zahlen ausgedrueckt, eine ganze Menge. Mehr als 60 Projekte stehen auf der nun in's fuenfte Jahr gehenden "Funding Liste", abgeschlossene und laufende (http://cordis.europa.eu/ist/cognition/projects.htm). Kostenpunkt: an die 250 Mio Euro. Fast zwanzig weitere kommen im naechsten Jahr dazu. In einem kurzen Referat wie diesem ist daher nur eine summarische Bewertung moeglich. Zum Beispiel kann man die Gesamtheit dieser Projekte nach diversen Kriterien strukturieren. Etwa nach den jeweiligen "kognitiven Kompetenzen", zu deren Implementierung ein gegebenes Projekt wesentliche Beitraege leistet. Schon der alte Aristoteles hatte hierzu Ideen, die, wie man auf diesem Bild sieht, auch heute noch aktuell sind.  Tatsaechlich lassen sich viele der erwaehnten Projekte mehr oder weniger praezise einer der auf der rechten Seite beschriebenen Ebenen zuordnen. Darunter und daneben gibt es solche, die sich insbesondere des Uebergangs der “anima sensitiva” vom "sub-symbolischen" zum "symbolischen" Bereich annehmen. So ergibt sich die folgende ganz grobe Klassifizierung:  Die Zeilen dieser Matrix sind mit verschiedenen Typen von "Environments" (oder "Umwelten") etikettiert, in denen Maschinen und Systeme mit ihren jeweiligen Kompetenzen wirken. Zu unterscheiden waeren etwa Alltagswelten, "digitale Welten" (zB Content-Netzwerke, Webs) und alle Arten von hybriden Varianten. Und ueberall muss gelernt werden. Diese Projekte sind es, die unsere Programme letztlich implementieren. Sie sollen innerhalb begrenzter Zeit einen Kenntnis-Fortschritt - wenn schon nicht Erkenntnis-Fortschritt - bringen, und im besten Falle auch wirtschaftlich umsetzbare konkrete Ergebnisse liefern. Dies ist nicht einfach. Besonders dann nicht, wenn, wie in unserem Programm, eine starke Betonung auf die Festigung der wissenschaftlichen Grundlagen gelegt wird. In diesem Sinne haben wir eine Art Maxime formuliert und potentiellen Antragstellern an's Herz gelegt: "Definiere dein Projekt durch harte Forschungs-Probleme und ambitioese aber relevante und realistische Szenarien, in denen (selbst eine Annaeherung an) die Loesung dieser Probleme einen messbaren Gewinn bringt." Und damit sind wir bei den "Anwendungen", zum Beispiel in Service und Produktion: Cui bono ? Darauf kann man lang und breit antworten und darueber auch trefflich streiten. Doch ich moechte mich hier auf die gleiche, sehr persoenliche und vielleicht etwas missionarische Antwort beschraenken, die ich in diesem Fruehjahr bei einem Panel zum Thema "Robot Ethics" im Rahmen der HRI’08 (Human-Robotics Interfaces) gegeben habe.  Eine der Fragen dort lautete: "Sollen wir (weiterhin) Forschung foerdern, die es ermoeglicht, autonome Agenten herzustellen, deren Gebrauch oder Missbrauch das Leiden von Menschen vergroessern kann?" Meine Antwort darauf: "Wir sollten Forschung foerdern, deren erwartete Resultate die Schaffung besserer Lebensbedingungen fuer alle Bewohner dieses Planeten ermoeglichen, und Forschung, die uns hilft, uns selbst und die Welt, in der wir leben, besser zu verstehen. Tatsaechlich ist das zweite eine Voraussetzung fuer das erste Ziel. Wir - betroffene Buerger (und Wissenschaftler und Ingenieure im Besonderen) – sollten alles tun, um zu verhindern, dass Forschungsergebnisse zur Vergroesserung menschlichen Leids missbraucht werden. Die Erfahrung zeigt, dass dies nicht leicht ist. Doch sollten wir nicht aufgeben." Wie geht es weiter ? Wir koennen es nur vermuten. Umberto Maturana und Francisco Varela, zwei in einschlaegigen Kreisen beruehmte (chilenische) Neurophysiologen und Kognitionsforscher sagten: "Leben ist Kognition". Diese Gleichsetzung ist zweifellos gewagt. Vielleicht sollte man die Aussage abschwaechen zu "Kein Leben ohne Kognition", worauf man sich (bei hinreichend grosszuegiger Auslegung des Kognitionsbegriffs) wohl leichter verstaendigen kann. Aber dann kann man natuerlich dennoch fragen; "Muessen die Dinge, denen wir kognitive Faehigkeiten zuerkennen, nicht in irgendeiner Weise lebendig sein?". Es ist daher nicht verwunderlich, dass Biomimetik auch im Bereich technischer Kognition um sich greift. Tatsaechlich hat Biomimetik eine lange Tradition, aelter noch als die Kybernetik der spaeten vierziger Jahre. Und spaetestens seit John von Neumanns zellularen Automaten und Conways "Game of Life" haben sich auch Informatiker in jene Disziplin eingemischt, die unter der Bezeichnung "Artificial Life" Karriere gemacht hat. Aber inzwischen wird nicht mehr nur per Software simuliert, sondern auch in spezieller Hardware emuliert, wie zum Beispiel in den EU Projekten PACE (Programmable Artificial Cell Evolution, http://www.istpace.org/) und FACETS (Fast Analog Computing with Emergent Transient States, http://facets.kip.uni-heidelberg.de/). PACE tut dies auf der Ebene der elementaren Bausteine des Lebens; FACETS, mit neuromorpher Hardware, auf der Ebene des “lebendigen” Denkens.  In gewisser Weise sind beide Projekte dem Paradigma des “Embodiment” verpflichtet, welches bei Proponenten der “new AI” beliebt ist, und diese wohl erst begruendet. Es postuliert die Untrennbarkeit von “Intelligenz und Koerperlichkeit” und letztlich die untrennbare Einheit von “Geist und Materie”. Oder, kuerzer: “Mind

Matters Matter!”

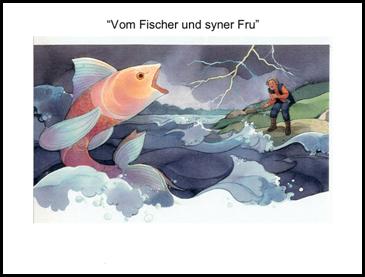

Und so mag es sein, dass wir so etwas wie neue Formen des Lebens schaffen muessen, wenn wir bei unserem Bemuehen, kuenstliche kognitive Systeme zu bauen, wirklich entscheidende Fortschritte machen wollen. Das ist nicht ohne Risiko, zumal wenn wir dabei in den Bereich von Nano-Objekten vorstossen. Aber es gibt natuerlich noch mehr Risiken. Ich will deshalb mit einer Kurzfassung eines meiner Lieblingsmaerchen schliessen, des Maerchens “Vom Fischer und syner Fru”:  Der verzauberte Butt, den der Fischer eines Tages bei ruhiger See gefangen und wieder frei gelassen hatte, erfuellte voll Dankbarkeit jeden Wunsch der Frau des Fischers. Er befoerderte sie aus der alten, grauen Kate bis hin zum paepstlichen Thron, machte sie immer reicher und maechtiger. Schliesslich wollte die Frau wie Gott sein. Als der Butt dies hoerte, sagte er zum Fischer: “Geh nach Hause, da sitzt sie wieder in ihrer alten Kate”. Und die Wellen gingen haushoch im tosenden Sturm. Der Interpretationen gibt es sicher viele. Eine Moral von der Geschicht koennte jedenfalls sein: Wir sollten gut bedenken, was wir uns wuenschen, wenn wir glauben, es haben oder tun zu koennen. Nicht nur im Maerchen sondern auch im wahren Leben. * Vortrag in geschlossener Gesellschaft, am 18 Oktober 2008 |